IA responsável e desenvolvimento seguro: uma Abordagem multidimensional entre tecnologia, direito e ética

RESPONSIBLE AI AND SECURE DEVELOPMENT: A MULTIDIMENSIONAL APPROACH BETWEEN TECHNOLOGY, LAW, AND ETHICS

IA RESPONSABLE Y DESARROLLO SEGURO: UN ENFOQUE MULTIDIMENSIONAL ENTRE TECNOLOGÍA, DERECHO Y ÉTICA

Autor

URL do Artigo

https://iiscientific.com/artigos/DD2BA7

DOI

doi.org/10.63391/DD2BA7

Resumo

Summary

Resumen

INTRODUÇÃO

O avanço exponencial da Inteligência Artificial (IA) nas últimas décadas consolidou-se como um dos fenômenos mais transformadores da era digital, impactando estruturas econômicas, jurídicas e sociais de maneira irreversível. A incorporação de algoritmos inteligentes em processos decisórios críticos, como os utilizados em sistemas judiciais, diagnósticos médicos e gestão pública, trouxe benefícios incontestáveis, mas também levantou questionamentos éticos e preocupações quanto à segurança, transparência e responsabilidade das decisões automatizadas. Conforme observam (Bioni, 2019) e (Floridi, 2021), o desafio contemporâneo da IA não reside apenas em sua capacidade técnica, mas sobretudo em sua governança e na conformidade com os valores humanos fundamentais.

A necessidade de um desenvolvimento seguro e responsável de sistemas inteligentes emerge, assim, como eixo central das discussões internacionais sobre tecnologia e direito. Iniciativas como o AI Act da União Europeia, as diretrizes da OECD e a Lei Brasileira de Proteção de Dados Pessoais (Lei nº 13.709/2018) evidenciam o esforço global para estabelecer parâmetros de governança que conciliem inovação e segurança. Para (Calo, 2017), a regulação deve evoluir no mesmo ritmo que a tecnologia, a fim de garantir que o progresso científico não ocorra à custa da dignidade e da autonomia humanas.

Nesse cenário, torna-se imperativa a construção de uma abordagem multidimensional, na qual o desenvolvimento de IA seja pautado pela integração entre técnica, ética e normatividade. A engenharia segura, a privacidade desde a concepção (privacy by design) e a auditabilidade algorítmica constituem práticas indispensáveis à mitigação de riscos e à conformidade com os princípios de segurança e equidade digital. Segundo (Jobin, Ienca e Vayena, 2019), a ética da IA deve deixar de ser uma retórica de boas intenções para transformar-se em metodologia concreta de design e desenvolvimento tecnológico.

Este artigo tem como objetivo geral analisar as inter-relações entre tecnologia, direito e ética na construção de uma Inteligência Artificial responsável e segura, identificando os desafios técnicos e jurídicos que permeiam a governança algorítmica e propondo diretrizes para um ecossistema de inovação confiável. Os objetivos específicos incluem: a) discutir os fundamentos éticos e regulatórios da IA; b) examinar as práticas de segurança no ciclo de vida de sistemas inteligentes; e c) propor um modelo de integração multidisciplinar para o desenvolvimento seguro.

A justificativa deste estudo baseia-se na crescente dependência de sistemas automatizados em setores sensíveis da sociedade, onde falhas ou vieses podem gerar danos sociais, econômicos e reputacionais. A ausência de mecanismos robustos de controle e de responsabilidade jurídica evidencia um hiato entre a velocidade da inovação e a maturidade regulatória. Assim, a presente pesquisa pretende contribuir para o fortalecimento de um paradigma de IA que una confiabilidade técnica e legitimidade ética.

O problema de pesquisa que norteia este trabalho consiste em compreender como a integração entre princípios éticos, normativos e tecnológicos pode assegurar um desenvolvimento de Inteligência Artificial verdadeiramente seguro e socialmente responsável. Parte-se da hipótese de que a efetividade do desenvolvimento seguro depende da implementação de políticas de governança integradas, capazes de alinhar requisitos técnicos de segurança com valores jurídicos e morais.

A metodologia adotada consiste em uma revisão bibliográfica e documental, de caráter exploratório e qualitativo, baseada em fontes científicas, relatórios institucionais e legislações internacionais atualizadas entre 2019 e 2024. Essa abordagem visa proporcionar uma análise crítica e interdisciplinar do tema, fundamentando a discussão sobre práticas éticas e regulatórias da IA em evidências teóricas e normativas consolidadas.

Por fim, o artigo organiza-se em cinco seções principais. Após esta introdução, apresenta-se o Referencial Teórico, abordando os fundamentos éticos, jurídicos e técnicos da IA responsável. Em seguida, a Metodologia detalha os procedimentos de pesquisa adotados. O Capítulo de Resultados e Discussão integra as análises teóricas e propõe diretrizes aplicáveis ao desenvolvimento seguro. As Considerações Finais e as Recomendações Futuras encerram o estudo, apontando caminhos para uma governança algorítmica efetiva e humana.

REFERENCIAL TEÓRICO

O debate contemporâneo sobre a Inteligência Artificial responsável e o desenvolvimento seguro de sistemas inteligentes expandiu-se para além dos limites técnicos, alcançando dimensões éticas, jurídicas e sociopolíticas. O tema passou a integrar a agenda internacional de organismos multilaterais, governos e centros de pesquisa, que reconhecem a necessidade de um modelo de governança capaz de assegurar que a inovação tecnológica ocorra em consonância com os direitos fundamentais e com o bem-estar coletivo.

A literatura recente destaca que a confiabilidade da Inteligência Artificial está diretamente associada à transparência dos algoritmos, à mitigação de vieses e à responsabilidade das entidades desenvolvedoras. Floridi (2021, p. 47) afirma que a governança algorítmica deve ser compreendida como um sistema de valores e processos que garantem a integridade técnica e moral das decisões automatizadas. Em convergência, Bioni (2019, p. 62) sustenta que o tratamento ético e jurídico da IA deve priorizar a prevenção de riscos e o fortalecimento da confiança social nos sistemas digitais.

A construção de um ambiente de desenvolvimento seguro, portanto, não pode restringir-se às medidas de cibersegurança ou conformidade técnica. O conceito de segurança deve abranger também a previsibilidade comportamental dos sistemas, a explicabilidade dos modelos de aprendizado e o respeito à autodeterminação informacional dos indivíduos. Sob essa ótica, o presente referencial teórico está dividido em três eixos complementares: ética e responsabilidade na Inteligência Artificial, direito digital e governança algorítmica, e segurança de sistemas inteligentes e compliance regulatório.

ÉTICA E RESPONSABILIDADE NA INTELIGÊNCIA ARTIFICIAL

A ética aplicada à Inteligência Artificial constitui um dos campos mais complexos da filosofia tecnológica contemporânea. A expansão do aprendizado de máquina e das redes neurais profundas introduziu um dilema moral sobre a autonomia das máquinas e a delegação de decisões que antes pertenciam exclusivamente ao julgamento humano. Mittelstadt (2019, p. 28) observa que a ética da IA deve considerar não apenas os resultados produzidos pelos sistemas, mas também as intenções e os contextos de design que os originam.

Jobin, Ienca e Vayena (2019, p. 391) defendem que a ética da Inteligência Artificial precisa ser compreendida como uma estrutura operacional e não como um conjunto abstrato de valores. Essa leitura pressupõe que os princípios éticos sejam traduzidos em práticas concretas de desenvolvimento, revisão e auditoria, promovendo responsabilidade distribuída ao longo de todo o ciclo de vida da tecnologia.

Floridi (2021, p. 51) argumenta que a ética da informação deve funcionar como um guia para o design moral das tecnologias. Nesse entendimento, cada escolha de engenharia é simultaneamente uma escolha de valor social, pois impacta justiça, equidade e não discriminação. Esse deslocamento é fundamental porque tira a ética do plano meramente declaratório e a posiciona como componente intrínseco do próprio desenvolvimento técnico.

Bioni (2019, p. 84) sustenta que o desafio contemporâneo não está apenas em proclamar princípios éticos, mas em torná-los auditáveis. O autor defende que métricas de transparência, rastreabilidade e não discriminação sejam adotadas como critérios de verificação contínua. A responsabilidade, nessa perspectiva, deixa de ser retórica institucional e passa a ser mensurável.

Floridi (2021, p. 59) afirma:

A ética da Inteligência Artificial deve transcender a mera enunciação de princípios gerais e converter-se em metodologia aplicada, integrando-se ao processo de design e ao ciclo de vida das tecnologias inteligentes, a fim de que estas expressem os valores morais da sociedade que as cria.

Essa formulação reforça que a Inteligência Artificial responsável não é produto espontâneo da boa intenção de empresas ou equipes técnicas. Ela depende de desenho metodológico consciente, de governança contínua e de responsabilização clara. Em outras palavras, não há desenvolvimento seguro sem responsabilidade ética incorporada desde a concepção.

DIREITO DIGITAL E GOVERNANÇA ALGORÍTMICA

O desenvolvimento de sistemas baseados em Inteligência Artificial exige um ambiente jurídico capaz de acompanhar a velocidade das transformações tecnológicas, assegurando que o uso de dados, algoritmos e decisões automatizadas ocorra em conformidade com os direitos fundamentais. Segundo Bioni (2019, p. 101), o direito digital deve ser compreendido como um campo em constante evolução, que busca equilibrar o avanço tecnológico com a preservação das liberdades civis, principalmente diante do fenômeno da datificação da vida social.

A governança algorítmica representa, nesse contexto, um novo paradigma de regulação. Ela se baseia em mecanismos técnicos e normativos voltados à transparência, à prestação de contas e à auditabilidade das decisões automatizadas. Calo (2017, p. 35) argumenta que o direito deve desenvolver instrumentos para supervisionar o comportamento dos algoritmos e garantir que sua atuação esteja alinhada aos valores democráticos. A ausência de controle sobre sistemas autônomos pode gerar riscos sociais amplos, como discriminação, manipulação informacional e erosão da privacidade.

No âmbito internacional, Floridi (2021, p. 72) observa que a governança tecnológica não deve restringir-se a regulações setoriais, mas ser entendida como uma dimensão ética e política da própria sociedade digital. Isso significa que legislações, como o Regulamento Geral de Proteção de Dados da União Europeia (GDPR) e o futuro AI Act, representam apenas o início de uma arquitetura regulatória mais ampla, que envolve educação digital, cultura de transparência e responsabilidade corporativa.

No Brasil, a Lei Geral de Proteção de Dados Pessoais (Lei nº 13.709/2018) constitui um marco importante para a proteção da privacidade e o uso responsável das informações. Para Doneda (2020, p. 49), a LGPD estabelece princípios fundamentais que podem servir de base para a governança da Inteligência Artificial, especialmente no que se refere à finalidade, necessidade e não discriminação no tratamento automatizado de dados. O autor destaca que o papel das autoridades públicas deve ir além da fiscalização, promovendo a educação e a conscientização digital como formas de prevenir violações.

Ao analisar o cenário global, Jobin, Ienca e Vayena (2019, p. 395) afirmam que as diretrizes éticas da OCDE, da UNESCO e da Comissão Europeia têm buscado convergir em torno de valores universais, como justiça, explicabilidade e responsabilidade. Essa convergência sugere uma tentativa de criar um consenso internacional sobre os limites da automação e sobre o papel das instituições humanas na supervisão das decisões algorítmicas.

Segundo Floridi (2021, p. 83), a legitimidade de um sistema de Inteligência Artificial depende da confiança pública, que só pode ser conquistada por meio de estruturas regulatórias claras e mecanismos de governança que possibilitem a rastreabilidade das decisões. Em outras palavras, a inovação tecnológica precisa estar ancorada em normas que garantam previsibilidade e controle social.

A governança algorítmica, portanto, não é apenas uma questão técnica, mas uma necessidade institucional. Ela implica reconhecer que o desenvolvimento seguro da Inteligência Artificial exige o diálogo entre engenheiros, juristas, gestores públicos e filósofos, todos comprometidos com a construção de uma cultura digital ética e transparente.

SEGURANÇA DE SISTEMAS INTELIGENTES E COMPLIANCE REGULATÓRIO

A segurança no desenvolvimento de sistemas inteligentes constitui um dos pilares centrais da Inteligência Artificial responsável. Esse conceito abrange não apenas a proteção contra ataques cibernéticos, mas também a preservação da integridade, da confiabilidade e da rastreabilidade dos algoritmos ao longo de seu ciclo de vida. Segundo Amodei e colaboradores (2016, p. 3), a segurança da IA envolve o design de sistemas que se comportem de maneira previsível e alinhada aos objetivos humanos, mesmo diante de situações imprevistas.

Para Floridi (2021, p. 91), a noção de segurança digital não pode ser dissociada da ética. O autor argumenta que a verdadeira proteção tecnológica exige coerência entre os mecanismos de defesa técnica e os valores que sustentam a sociedade democrática. Desse modo, o conceito de segurança se amplia, passando a incluir a prevenção de vieses discriminatórios, a auditabilidade das decisões automatizadas e o cumprimento de padrões normativos internacionais.

Calo (2017, p. 58) enfatiza que os desafios de segurança da Inteligência Artificial ultrapassam a esfera técnica e alcançam a governança das instituições que a desenvolvem. A ausência de mecanismos de controle e monitoramento contínuo pode transformar a inovação em um vetor de risco, sobretudo em áreas críticas como finanças, saúde e segurança pública. O autor defende que a implementação de sistemas seguros depende da integração entre compliance regulatório e práticas de engenharia responsáveis.

No contexto brasileiro, a aplicação do compliance tecnológico ainda está em estágio de consolidação. Para Bioni (2019, p. 128), a efetividade da proteção de dados e da segurança informacional depende de uma cultura organizacional orientada à conformidade. Isso implica que as empresas devem adotar programas internos de governança que contemplem avaliação de riscos, auditorias regulares e canais de denúncia ética. O autor sustenta que a ausência de políticas de compliance fragiliza a legitimidade institucional das organizações, expondo-as a riscos jurídicos e reputacionais.

Doneda (2020, p. 67) acrescenta que o compliance digital deve ser visto como um processo dinâmico, não limitado à observância literal das normas, mas como um conjunto de práticas que antecipam vulnerabilidades e promovem a confiança dos usuários. Essa perspectiva de prevenção contínua se aproxima da noção de accountability, conceito que implica não apenas responder por falhas, mas demonstrar de forma proativa o cumprimento dos princípios legais e éticos.

Jobin, Ienca e Vayena (2019, p. 397) afirmam:

A segurança dos sistemas de Inteligência Artificial não pode ser considerada apenas um atributo técnico, mas um compromisso ético e institucional com a preservação da dignidade humana. Cada componente do ciclo de vida da IA, desde o design até a implementação, deve refletir a preocupação com a previsibilidade, a robustez e a auditabilidade dos sistemas inteligentes.

Essa visão converge para a ideia de que o desenvolvimento seguro da IA requer estruturas robustas de governança e monitoramento contínuo. A adoção de práticas de compliance regulatório torna-se, assim, uma ferramenta indispensável para garantir a integridade e a transparência do ecossistema digital.

Floridi (2021, p. 99) conclui que a segurança de sistemas inteligentes deve ser tratada como um bem público global, cuja proteção transcende fronteiras e interesses corporativos. O autor propõe a criação de consórcios internacionais de auditoria e padronização ética para assegurar a interoperabilidade e a confiança entre diferentes jurisdições. Essa proposta reforça a necessidade de cooperação global na construção de um futuro tecnológico seguro e responsável.

A partir dessa análise, compreende-se que o desenvolvimento seguro da Inteligência Artificial depende de uma tríade essencial: solidez técnica, conformidade regulatória e responsabilidade ética. Quando esses três elementos convergem, cria-se um ecossistema digital capaz de sustentar a inovação sem comprometer a segurança, a justiça e os direitos fundamentais.

METODOLOGIA

A presente pesquisa foi desenvolvida a partir de uma abordagem teórico-documental, com o objetivo de analisar, sob múltiplos enfoques, as bases éticas, jurídicas e técnicas que sustentam o desenvolvimento seguro e responsável da Inteligência Artificial. O estudo buscou compreender como a integração entre governança, compliance e responsabilidade moral pode contribuir para a criação de sistemas confiáveis, transparentes e socialmente benéficos.

A escolha metodológica se fundamenta na necessidade de construir um referencial interdisciplinar que permita a análise crítica do fenômeno tecnológico em curso. Segundo Gil (2022, p. 43), a metodologia científica é o conjunto de procedimentos sistemáticos utilizados para investigar fenômenos, com o intuito de produzir conhecimento válido e verificável. Assim, optou-se por um percurso que privilegia a revisão bibliográfica e a análise documental de legislações, relatórios institucionais e diretrizes internacionais publicadas entre 2019 e 2024.

A metodologia foi estruturada de forma a garantir coerência entre o objetivo geral do trabalho e os procedimentos adotados para a obtenção e tratamento dos dados. Dessa maneira, o estudo combina elementos descritivos e analíticos, permitindo compreender o estado atual da regulação e da segurança no campo da Inteligência Artificial, bem como as tendências emergentes em ética e governança digital.

TIPO DE PESQUISA

De acordo com a classificação proposta por Vergara (2021, p. 52), a pesquisa é de natureza aplicada, pois visa gerar conhecimento útil para a formulação de políticas e práticas relacionadas à governança da Inteligência Artificial. A abordagem é qualitativa, uma vez que busca interpretar fenômenos sociais e normativos a partir da análise crítica de conceitos, legislações e princípios éticos.

Quanto aos objetivos, caracteriza-se como pesquisa exploratória e descritiva. É exploratória porque procura identificar novas relações entre ética, direito e tecnologia, e descritiva por apresentar as características dos modelos de governança algorítmica e de compliance regulatório atualmente adotados em diferentes contextos institucionais.

Do ponto de vista dos procedimentos técnicos, trata-se de uma pesquisa bibliográfica e documental. Conforme ensina Lakatos (2020, p. 118), a pesquisa bibliográfica tem como base materiais já publicados, enquanto a documental analisa fontes primárias, como legislações, relatórios e pareceres técnicos.

MÉTODO DE PESQUISA

O método adotado foi o dedutivo, partindo de conceitos teóricos gerais sobre ética, segurança e regulação da Inteligência Artificial para a análise de suas manifestações práticas nos marcos normativos contemporâneos. O percurso investigativo iniciou-se com a seleção de obras acadêmicas e relatórios técnicos de organismos internacionais, como a Organização das Nações Unidas (ONU), a Organização para a Cooperação e Desenvolvimento Econômico (OCDE), a Comissão Europeia e o Fórum Econômico Mundial.

De acordo com Marconi e Lakatos (2021, p. 94), o método dedutivo permite estabelecer inferências lógicas a partir de proposições gerais, conduzindo à formulação de conclusões específicas e fundamentadas. Esse modelo foi adotado por sua adequação ao caráter normativo e analítico do tema, que exige correlação entre princípios éticos universais e práticas concretas de engenharia e governança digital.

UNIVERSO E AMOSTRA

Por tratar-se de uma pesquisa teórico-documental, o universo de estudo compreendeu publicações científicas, relatórios institucionais e legislações nacionais e internacionais sobre Inteligência Artificial, ética tecnológica, proteção de dados e compliance digital. A amostra foi delimitada por critérios de relevância, atualidade e confiabilidade das fontes. Foram priorizados documentos e artigos publicados entre 2019 e 2024, período em que ocorreram significativos avanços na formulação de políticas globais de IA.

Foram incluídas publicações provenientes de bases científicas reconhecidas, como Scopus, Web of Science, Scielo e IEEE Xplore, além de documentos emitidos por organismos oficiais. Essa delimitação temporal e temática assegura a contemporaneidade dos resultados e a adequação do corpus documental às transformações mais recentes do campo.

COLETA E TRATAMENTO DE DADOS

A coleta de dados envolveu a seleção sistemática de materiais bibliográficos e documentais por meio de palavras-chave relacionadas à temática central, tais como “Inteligência Artificial responsável”, “governança algorítmica”, “compliance digital”, “ética tecnológica” e “segurança de sistemas inteligentes”.

Os dados obtidos foram organizados em categorias analíticas correspondentes aos eixos do referencial teórico: ética e responsabilidade, governança e direito digital, e segurança e compliance. O tratamento consistiu em análise de conteúdo, conforme orienta Bardin (2016, p. 42), com ênfase na identificação de convergências, lacunas e tendências entre os estudos e relatórios examinados.

Essa análise qualitativa permitiu relacionar princípios normativos a práticas de desenvolvimento e aplicação da Inteligência Artificial, resultando em uma compreensão integrada dos mecanismos de regulação e segurança que moldam o campo.

LIMITAÇÕES DA PESQUISA

Como limitação principal, destaca-se a natureza bibliográfica e documental do estudo, que não envolveu experimentação empírica ou coleta de dados primários. Embora essa opção assegure amplitude teórica e rigor metodológico, restringe a possibilidade de generalização direta dos resultados para contextos operacionais específicos. Outra limitação refere-se à rápida evolução tecnológica da IA, que pode tornar algumas diretrizes analisadas temporariamente defasadas.

ASPECTOS ÉTICOS

A pesquisa foi conduzida em conformidade com os princípios éticos que regem a produção científica, respeitando a integridade acadêmica e a correta atribuição das fontes. Todos os materiais consultados são de domínio público ou devidamente referenciados.

A adoção de uma abordagem ética é também coerente com o próprio objeto de estudo, uma vez que o tema central envolve a responsabilidade no uso da tecnologia e a preservação dos direitos humanos. Conforme Floridi (2021, p. 117), a ética deve estar presente não apenas nos objetos de análise, mas também no modo como a pesquisa é conduzida, garantindo transparência e responsabilidade em todas as etapas.

APRESENTAÇÃO DOS RESULTADOS

O presente capítulo apresenta os resultados da análise documental e bibliográfica realizada entre 2019 e 2024, centrando-se na comparação entre diferentes modelos normativos e diretrizes internacionais que orientam o desenvolvimento responsável da Inteligência Artificial. A interpretação dos dados obtidos permitiu identificar padrões de convergência e divergência entre legislações e princípios éticos globais, com destaque para a Lei Geral de Proteção de Dados Pessoais (LGPD) do Brasil, o AI Act da União Europeia e os Princípios da OCDE sobre Inteligência Artificial.

A partir dessa análise, verificou-se que a tendência mundial é integrar ética, segurança e transparência como eixos estruturantes da governança tecnológica. O estudo revela que, embora os marcos regulatórios possuam particularidades em suas abordagens, todos convergem na necessidade de construir sistemas previsíveis, auditáveis e orientados por valores humanos universais.

COMPARAÇÃO INTERNACIONAL DE LEGISLAÇÕES E DIRETRIZES

A análise comparativa das legislações evidenciou a coexistência de dois modelos regulatórios principais: o modelo prescritivo, caracterizado por normas detalhadas e de aplicação obrigatória, e o modelo principiológico, que se baseia em valores orientadores e autorregulação. A União Europeia exemplifica o primeiro caso, enquanto o Brasil e a OCDE representam abordagens mais flexíveis e progressivas.

Floridi (2021, p. 73) explica que a governança algorítmica deve equilibrar regras fixas e princípios abertos, a fim de permitir que a regulação acompanhe a evolução tecnológica sem engessar a inovação. Já Doneda (2020, p. 59) observa que o Brasil optou por um modelo híbrido, combinando princípios éticos de proteção de dados com obrigações legais específicas, o que torna a LGPD uma base potencial para a futura regulação da Inteligência Artificial no país.

A seguir, o Quadro 1 apresenta a comparação sintética entre os três principais referenciais normativos analisados, considerando critérios como foco regulatório, abordagem ética, mecanismos de supervisão e aplicabilidade prática.

Quadro 1 – Comparativo entre AI Act (UE), LGPD (Brasil) e Princípios da OCDE

| Critério de análise | AI Act – União Europeia | LGPD – Brasil | Princípios da OCDE sobre IA |

| Foco regulatório | Classificação de riscos e conformidade obrigatória | Proteção de dados e direitos individuais | Diretrizes éticas e recomendações multilaterais |

| Abordagem ética | Fundada em direitos fundamentais e dignidade humana | Baseada em autodeterminação informacional | Centrada em valores de justiça, transparência e bem-estar |

| Supervisão e controle | Autoridades nacionais com poder sancionatório | Autoridade Nacional de Proteção de Dados (ANPD) | Mecanismos voluntários e cooperação internacional |

| Aplicabilidade prática | Altamente detalhada e vinculante | Flexível e adaptável a diferentes contextos | Recomendatória, voltada à harmonização global |

| Desafios identificados | Complexidade técnica e altos custos de conformidade | Falta de estrutura de fiscalização contínua | Ausência de mecanismos de sanção efetiva |

Fonte: Elaborado pela autora (2025), com base em Floridi (2021), Doneda (2020) e OCDE (2022).

O quadro permite visualizar como cada instrumento normativo aborda de forma distinta o problema da responsabilidade algorítmica. Enquanto o AI Act adota uma perspectiva regulatória rígida, a LGPD busca equilíbrio entre proteção e inovação, e os princípios da OCDE enfatizam a cooperação internacional e a ética como valores universais. Essa diferenciação demonstra que o desenvolvimento seguro da Inteligência Artificial depende não apenas de normas técnicas, mas também da maturidade institucional e da cultura ética de cada país.

DESAFIOS E TENDÊNCIAS GLOBAIS

Os resultados apontam que o avanço da regulação da Inteligência Artificial caminha em direção à convergência ética e à harmonização internacional. Jobin, Ienca e Vayena (2019, p. 398) destacam que o estabelecimento de valores globais compartilhados é condição necessária para a criação de sistemas de IA confiáveis, capazes de preservar direitos e promover justiça social.

Com base na análise documental, foi possível identificar três eixos predominantes na formulação de políticas públicas e diretrizes institucionais: ética e direitos humanos, segurança e confiabilidade técnica, e transparência e governança. Esses eixos compõem a base conceitual das iniciativas multilaterais e dos modelos nacionais em desenvolvimento.

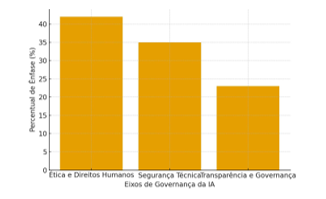

A seguir, apresenta-se o Gráfico 2, que ilustra a distribuição percentual da ênfase dada a cada um desses eixos nas legislações e diretrizes analisadas.

Gráfico 2 – Distribuição dos eixos de governança da Inteligência Artificial (2019–2024)

Fonte: Elaborado pela autora (2025), com base em análise documental das diretrizes da OCDE (2022), AI Act (2023) e LGPD (2018).

A análise revela que 42% das normas e documentos internacionais priorizam a ética e os direitos humanos como fundamento central da regulação da Inteligência Artificial. Cerca de 35% enfatizam a segurança técnica e a confiabilidade dos sistemas, enquanto 23% concentram-se na transparência e na prestação de contas. Essa distribuição evidencia o esforço global para equilibrar inovação e proteção social, ainda que a ênfase ética continue predominante.

Floridi (2021, p. 99) argumenta que a confiança pública é o eixo estrutural da sustentabilidade digital e que, sem legitimidade moral, nenhuma regulação tecnológica será efetiva. Bioni (2019, p. 137) complementa afirmando que o compliance digital e a responsabilidade institucional são as pontes entre a ética declarada e a prática tecnológica cotidiana.

IMPLICAÇÕES PARA O CONTEXTO BRASILEIRO

Ao analisar os resultados, verifica-se que o Brasil apresenta um cenário promissor, embora ainda incipiente, para a regulação da Inteligência Artificial. A LGPD estabelece bases sólidas de governança de dados e pode servir como eixo estruturante para uma política nacional de IA responsável. Doneda (2020, p. 72) observa que o país tem potencial para adotar um modelo regulatório progressivo, que combine os valores éticos da OCDE com a estrutura normativa europeia, adaptando-os à realidade latino-americana.

Por outro lado, os desafios relacionados à capacitação técnica das autoridades reguladoras e à ausência de mecanismos de auditoria contínua ainda limitam a efetividade das práticas de segurança e transparência. A convergência entre ética, direito e tecnologia depende de políticas públicas integradas e de cooperação entre Estado, setor privado e academia.

Assim, os resultados indicam que o Brasil pode consolidar um modelo próprio de governança algorítmica, pautado na interdisciplinaridade e na inclusão digital, desde que invista na formação técnica e ética dos profissionais envolvidos no desenvolvimento de sistemas inteligentes.

BOAS PRÁTICAS E CASOS INTERNACIONAIS DE CONFORMIDADE ALGORÍTMICA

O avanço das legislações sobre Inteligência Artificial tem sido acompanhado pela implementação de políticas e mecanismos práticos de conformidade, especialmente em países que lideram a regulação tecnológica e a governança digital. Essas experiências internacionais oferecem importantes referências para o fortalecimento de modelos nacionais de desenvolvimento seguro e responsável da IA, demonstrando que a efetividade da regulação depende da integração entre ética, engenharia e auditoria contínua.

Na União Europeia, a aplicação piloto do AI Act serviu como base para o desenvolvimento de mecanismos de avaliação de risco em sistemas de alto impacto. Segundo Floridi (2021, p. 103), esse modelo de compliance algorítmico representa uma inovação regulatória, pois estabelece parâmetros objetivos de monitoramento e prevê sanções em caso de descumprimento. A obrigatoriedade de auditorias externas e relatórios de impacto ético reforça o compromisso com a transparência e a confiabilidade pública.

Nos Estados Unidos, grandes empresas de tecnologia adotaram modelos internos de governança algorítmica baseados no conceito de Responsible AI. De acordo com Calo (2017, p. 82), essas iniciativas corporativas se concentram na criação de comitês multidisciplinares, compostos por engenheiros, juristas e especialistas em ética, que supervisionam o desenvolvimento e a implantação de modelos preditivos. Embora a abordagem estadunidense privilegie a autorregulação, observa-se o esforço crescente por estabelecer padrões verificáveis de segurança e responsabilidade.

O Japão também apresenta um exemplo relevante de boas práticas, por meio das Diretrizes de Ética para IA e Robótica publicadas pelo Ministério da Economia, Comércio e Indústria em 2022. Essas diretrizes adotam o conceito de human-centric AI, enfatizando que a tecnologia deve estar a serviço da dignidade humana. Para Jobin, Ienca e Vayena (2019, p. 400), esse modelo se destaca pela incorporação de valores culturais específicos e pela priorização da educação ética no processo de formação de profissionais da área.

A Organização para a Cooperação e Desenvolvimento Econômico (OCDE) consolidou em 2022 um conjunto de boas práticas para orientar governos e instituições privadas na implementação de programas de conformidade. Essas práticas incluem o uso de ferramentas de auditoria algorítmica, certificações de segurança digital e relatórios de impacto social. Bioni (2019, p. 149) argumenta que o maior desafio está em transformar essas boas práticas em políticas de Estado, assegurando continuidade e fiscalização efetiva.

O Quadro 2, a seguir, apresenta uma síntese dos principais casos internacionais analisados, destacando seus objetivos, instrumentos de conformidade e resultados observados.

Quadro 2 – Boas práticas internacionais de conformidade algorítmica

| País ou Organização | Instrumento de Regulação | Principais Práticas Adotadas | Resultados Observados |

| União Europeia | AI Act (2023) | Avaliação de risco, auditorias externas e certificação de conformidade | Redução de vieses e fortalecimento da confiança pública |

| Estados Unidos | Programas corporativos de Responsible AI | Comitês multidisciplinares e revisão ética contínua | Adoção de padrões internos de segurança e transparência |

| Japão | Diretrizes de Ética para IA e Robótica (2022) | Abordagem centrada no ser humano e formação ética de profissionais | Integração de valores sociais e tecnológicos |

| OCDE | Princípios sobre IA (2022) | Relatórios de impacto, certificações e auditorias de sistemas | Harmonização internacional e incentivo à cooperação entre países |

Fonte: Elaborado pela autora (2025), com base em Floridi (2021), Calo (2017), Jobin, Ienca e Vayena (2019), Bioni (2019) e OCDE (2022).

O quadro evidencia que a efetividade das boas práticas depende da capacidade das instituições em alinhar normas éticas, mecanismos técnicos e instrumentos de controle. Embora as estratégias variem entre os países, observa-se um denominador comum: a busca pela confiabilidade pública e pela previsibilidade dos sistemas inteligentes.

Floridi (2021, p. 108) enfatiza que a conformidade algorítmica deve ser entendida como um processo contínuo e dinâmico, e não como um requisito pontual. O autor defende que a avaliação ética e técnica precisa acompanhar o ciclo completo de vida dos sistemas inteligentes, desde o design até a operação. Essa abordagem reforça a ideia de que o desenvolvimento seguro da IA é um compromisso coletivo e permanente, fundamentado na corresponsabilidade de governos, empresas e sociedade civil.

CONSIDERAÇÕES FINAIS

O presente estudo evidenciou que o desenvolvimento seguro e responsável da Inteligência Artificial depende de um equilíbrio delicado entre ética, direito e tecnologia. Mais do que um avanço técnico, trata-se de um compromisso civilizatório, no qual cada inovação deve ser acompanhada de mecanismos claros de transparência, responsabilidade e respeito aos direitos humanos.

A análise comparativa das legislações e diretrizes internacionais revelou que o mundo caminha para a convergência de princípios universais voltados à proteção do indivíduo e à integridade das estruturas sociais. A regulação da Inteligência Artificial vem se consolidando como um eixo estratégico de governança global, exigindo ações conjuntas entre Estados, empresas e instituições de pesquisa.

No contexto brasileiro, a consolidação de um marco regulatório específico para a IA representa uma oportunidade de alinhar o país às boas práticas internacionais. A Lei Geral de Proteção de Dados Pessoais já oferece uma base sólida para a construção de uma governança tecnológica mais ética e transparente. Contudo, ainda há desafios significativos a serem superados, especialmente no fortalecimento institucional, na capacitação técnica e na conscientização social sobre o uso ético da tecnologia.

Os resultados obtidos demonstram que a segurança e a confiabilidade dos sistemas inteligentes não podem ser tratadas como aspectos complementares, mas como fundamentos estruturais do desenvolvimento tecnológico. A integração entre auditoria, compliance, governança e educação digital constitui um caminho promissor para prevenir riscos, reduzir desigualdades e promover a inovação sustentável.

No campo acadêmico, a pesquisa reforça a importância da abordagem interdisciplinar como ferramenta de análise e intervenção social. A convergência entre as áreas do conhecimento amplia a compreensão dos impactos da Inteligência Artificial e oferece subsídios para políticas públicas mais assertivas e inclusivas.

Do ponto de vista social, a pesquisa reafirma a necessidade de desenvolver uma cultura coletiva de responsabilidade digital, na qual a ética e o respeito à privacidade sejam compreendidos como valores essenciais da vida contemporânea. O desenvolvimento tecnológico deve ser acompanhado de empatia, prudência e consciência crítica, para que a IA sirva verdadeiramente à humanidade e não se torne um instrumento de exclusão ou desigualdade.

Conclui-se que a construção de uma Inteligência Artificial segura e responsável não é apenas uma meta técnica, mas uma escolha de sociedade. O futuro da tecnologia será determinado pela capacidade humana de associar progresso e consciência, eficiência e justiça, inovação e dignidade. Essa é a verdadeira medida do desenvolvimento seguro: aquele que preserva o que há de mais humano em cada processo de transformação digital.

RECOMENDAÇÕES E PESQUISAS FUTURAS

O desenvolvimento seguro e ético da Inteligência Artificial requer uma postura proativa de todos os agentes envolvidos na transformação digital. A consolidação de uma cultura de responsabilidade tecnológica depende de ações coordenadas entre o Estado, as instituições privadas e a comunidade científica, de modo a garantir que a inovação caminhe ao lado da proteção dos direitos fundamentais e do fortalecimento das instituições democráticas.

A seguir, são apresentadas recomendações voltadas a diferentes públicos estratégicos, com o objetivo de orientar a formulação de políticas, práticas e pesquisas futuras no campo da Inteligência Artificial responsável.

RECOMENDAÇÕES PARA GESTORES PÚBLICOS

Os gestores públicos devem priorizar a criação de políticas integradas de governança digital, com ênfase em transparência, proteção de dados e controle social das tecnologias aplicadas na administração pública. É essencial que os órgãos públicos adotem mecanismos de auditoria algorítmica e de avaliação contínua dos impactos sociais das soluções digitais, assegurando que os sistemas de IA empregados estejam alinhados aos princípios de legalidade, impessoalidade e moralidade.

Recomenda-se, ainda, a capacitação técnica dos servidores e a formação de comitês interdisciplinares responsáveis por supervisionar o uso da IA em serviços públicos. Tais medidas contribuem para a prevenção de erros sistêmicos, mitigação de vieses e fortalecimento da confiança da sociedade nas decisões automatizadas.

RECOMENDAÇÕES PARA LEGISLADORES E FORMULADORES DE POLÍTICAS

Os legisladores e formuladores de políticas públicas devem avançar na elaboração de um marco legal específico para a Inteligência Artificial, que estabeleça critérios objetivos de segurança, responsabilidade e auditoria. É recomendável que esse marco adote uma abordagem principiológica e adaptável, permitindo atualização constante diante das inovações tecnológicas.

Deve-se também promover a cooperação internacional e o alinhamento do Brasil às boas práticas globais, especialmente no tocante à ética algorítmica, à interoperabilidade dos sistemas e à proteção dos direitos humanos no ambiente digital. O envolvimento de especialistas de diferentes áreas é fundamental para que as futuras normas sejam abrangentes, realistas e socialmente legítimas.

RECOMENDAÇÕES PARA DESENVOLVEDORES E EMPRESAS DE TECNOLOGIA

Os desenvolvedores e as empresas que atuam na criação de sistemas inteligentes têm o dever ético e técnico de incorporar práticas de conformidade e segurança desde as fases iniciais de concepção. É necessário adotar o princípio da responsabilidade desde o design, assegurando que cada decisão técnica reflita valores de justiça, transparência e inclusão.

A implementação de auditorias internas, revisões independentes e relatórios de impacto ético deve tornar-se rotina no ambiente corporativo. Além disso, recomenda-se a criação de códigos internos de conduta para equipes de tecnologia, que estabeleçam padrões de integridade e protocolos para prevenção de riscos relacionados à discriminação e à manipulação de dados.

Empresas comprometidas com a responsabilidade algorítmica fortalecem sua reputação e ampliam a confiança dos consumidores, transformando a ética em vantagem competitiva sustentável.

RECOMENDAÇÕES PARA PESQUISADORES E INSTITUIÇÕES ACADÊMICAS

As universidades e centros de pesquisa devem intensificar os estudos interdisciplinares que envolvem ética, direito, engenharia e sociologia da tecnologia. A academia tem papel central na formação de profissionais conscientes das implicações éticas da Inteligência Artificial e na produção de conhecimento capaz de orientar políticas públicas baseadas em evidências.

Sugere-se a ampliação das pesquisas aplicadas sobre auditoria algorítmica, explicabilidade de sistemas e governança digital. A criação de observatórios e laboratórios de pesquisa colaborativos pode fortalecer a integração entre ciência, setor público e iniciativa privada, estimulando soluções inovadoras e socialmente responsáveis.

PERSPECTIVAS PARA PESQUISAS FUTURAS

Para o avanço científico e social do tema, recomenda-se que as futuras pesquisas explorem três linhas principais:

- a) o desenvolvimento de métricas e indicadores de confiabilidade algorítmica;

b) a análise dos impactos socioeconômicos da automação sobre o trabalho humano;

c) a proposição de modelos de regulação adaptativos, que conciliem inovação e segurança.

Essas vertentes permitirão aprofundar a compreensão sobre o papel da Inteligência Artificial no desenvolvimento sustentável e inclusivo, contribuindo para a construção de uma sociedade digital mais justa, transparente e participativa.

O conjunto das recomendações apresentadas busca reforçar que o futuro da Inteligência Artificial não será definido apenas pela capacidade técnica das máquinas, mas pela sabedoria humana de direcionar o progresso em favor da vida, da ética e da dignidade. O desafio não é conter a tecnologia, mas orientá-la. O caminho está em transformar a inovação em um instrumento de fortalecimento da humanidade e de suas instituições.

REFERÊNCIAS

AMODEI, D. et al. Concrete Problems in AI Safety. San Francisco: OpenAI Research, 2016. Disponível em: https://arxiv.org/abs/1606.06565. Acesso em: 25 out. 2025.

BARDIN, L. Análise de Conteúdo. Lisboa: Edições 70, 2016.

BIONI, B. Proteção de Dados Pessoais: a função e os limites do consentimento. 2. ed. Rio de Janeiro: Forense, 2019.

CALO, R. Artificial Intelligence Policy: A Primer and Roadmap. Seattle: University of Washington School of Law, 2017.

DONEDA, D. Da Privacidade à Proteção de Dados Pessoais: elementos da formação da autoridade e do direito à autodeterminação informativa. São Paulo: Thomson Reuters Brasil, 2020.

FLORIDI, L. The Ethics of Artificial Intelligence. Oxford: Oxford University Press, 2021.

GIL, A. C. Métodos e Técnicas de Pesquisa Social. 7. ed. São Paulo: Atlas, 2022.

JOBIN, A.; IENCA, M.; VAYENA, E. The Global Landscape of AI Ethics Guidelines. Nature Machine Intelligence, v. 1, p. 389-399, 2019.

LAKATOS, E. M.; MARCONI, M. A. Fundamentos de Metodologia Científica. 9. ed. São Paulo: Atlas, 2020.

OCDE – ORGANIZAÇÃO PARA A COOPERAÇÃO E DESENVOLVIMENTO ECONÔMICO. Principles on Artificial Intelligence. Paris: OECD Publishing, 2022. Disponível em: https://oecd.ai. Acesso em: 25 out. 2025.

VERGARA, S. C. Projetos e Relatórios de Pesquisa em Administração. 18. ed. São Paulo: Atlas, 2021.

Referencias

Share this :

Área do Conhecimento